当很多 AI 公司还就是否该走开源路线而感到左右为难时,阿里的技术团队又开源了一个新的模型 —— 万相(Wan)视频生成大模型(包括全部推理代码和权重,最宽松的开源协议)。经常玩视频生成模型的同学应该知道,当前的很多模型仍然面临多方面挑战,比如难以还原复杂的人物动作,处理不好物体交互时的物理变化,遇到长文本指令就「选择性遵循」等。如果三个方面都做得比较好,那模型厂商多半是不舍得开源的。

阿里的做法与之不同。新开源的万相视频生成大模型不仅能展现旋转、跳跃、转身、翻滚等复杂动作,精准还原碰撞、反弹、切割等真实物理场景,还能准确理解中英文长文本指令,还原各种场景切换、角色互动。

官方demo:放不出来,图片太大

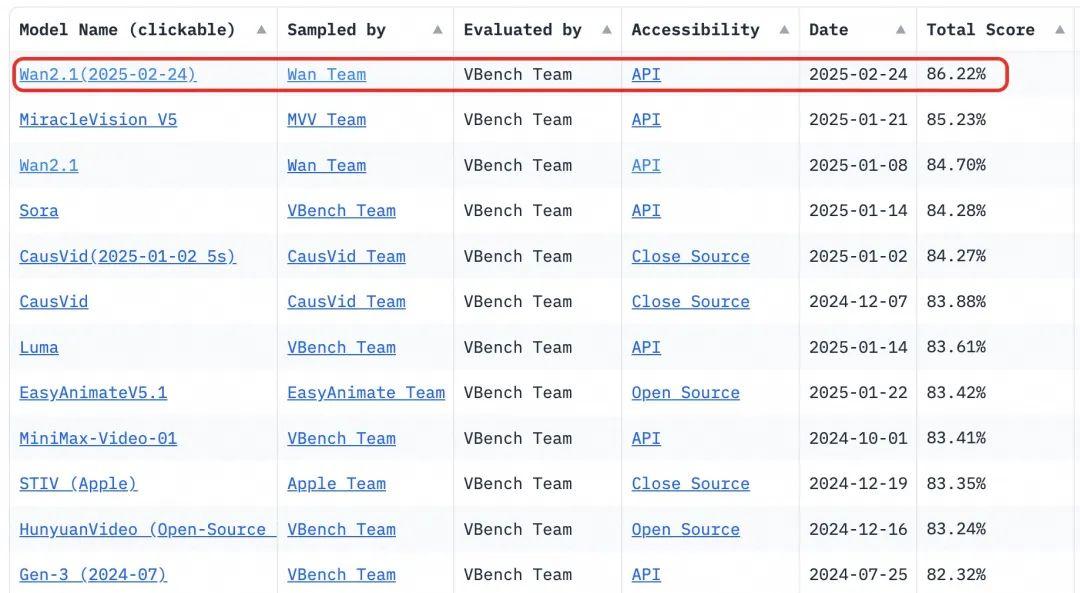

而对于有条件跑 14B 版本的同学,新模型可以提供更强的性能。权威评测集 VBench 的信息显示,万相大模型大幅领先 Sora、HunyuanVideo、Minimax、Luma、Gen3、Pika 等国内外视频生成模型,以总分 86.22% 的成绩登上榜首位置,成为视频生成领域的全新标杆。

实测性能:

它不仅是首个具备支持中文文字生成能力,还是同时支持中英文文字特效生成的视频生成模型。我们只需输入简短的文字描述,它就能生成具有电影级效果的文字和动画。什么特效字体、海报字体或者是其他真实场景下的字体,它通通能搞定。

比如,随着浅绿色烟雾缓缓消散,「阿里巴巴」四个大字逐渐显露,没有出现「鬼画符」,也没有错别字。

Prompt:动态电影镜头,浅绿色烟雾从画面顶部缓缓向下弥漫,逐渐覆盖整个屏幕。随着烟雾的扩散,画面慢慢淡出,切换到中央位置出现 “阿里阿巴巴” 四个大字。烟雾与 logo 之间的过渡自然流畅,营造出神秘而专业的氛围。背景为深色,突出 logo 的清晰度和视觉冲击力。近景特写镜头,缓慢推进效果。

复杂运动生成

历经一年多的进化,尽管大部分视频生成模型已经有了长足的进步,但面对旋转、跳跃、奔跑等复杂动作时仍会时不时「翻车」。万相在这方面下了狠功夫,如今它能够在多种场景下实现稳定的复杂运动生成,甚至还通过了部分视频生成中的图灵测试。我们让它生成一段男生在篮球场上投篮的画面,看似简单的场景,实则蕴含着复杂的运动规律和动态细节。一方面,投篮动作包含复杂的肢体协调和精细的手部动作,模型需要捕捉到运动员的跳跃、手臂的伸展、手腕的翻转以及手指对篮球的控制等。另一方面,篮球的运动轨迹也要符合物理规律,篮球形状不能出现扭曲或不自然的变化等。万相生成的视频中,球员弹跳、投篮的动作行云流水,篮球的运动轨迹也符合现实场景。

Prompt:球场上,一个健壮的男生弹跳起来投篮,篮球从篮筐中掉落下来。

Prompt:一只小狗在白雪覆盖的街道上欢快奔跑的生动场景。镜头捕捉到狗在中途奔跑的身影,它的皮毛上闪烁着雪花,展现出一种动感和活力。背景是轻轻飘落的雪花,营造出宁静的冬日氛围。街道两旁是被雪覆盖的树木和古色古香的房屋,房屋的屋顶被白色覆盖。光线柔和而漫射,仿佛是阴天,增强了舒适的寒冬感。构图采用低角度拍摄,突出小狗的顽皮精神,景深较浅,背景略显模糊,将焦点吸引到小狗身上。场景无缝循环,让狗狗在冬日仙境中的欢快情绪得以持续展现。

长文本遵循

万相在这方面,既听得懂「人话」,还能确保细节上不丢三落四。

Prompt:欢乐派对现场,一群多元种族的年轻人在宽敞明亮的客厅中央尽情舞动,活力四射。彩色气球与彩带装点空间,闪烁的灯光投射出迷幻光影,营造出节日般的氛围。他们穿着休闲时尚,随着节奏摆动身体,脸上洋溢着灿烂笑容,彼此眼神交流,流露出亲密与喜悦。背景中,有人倚靠沙发聊天,举杯畅饮,空气中弥漫着欢声笑语。纪实摄影风格,快门捕捉动态瞬间,中景广角视角。

Prompt:夜幕下的都市脉动,第一人视角 FPV 无人机穿梭于摩天大楼之间,高速飞行轨迹捕捉霓虹灯海。城市夜景如同流动的彩色画卷,灯火阑珊,光影交织。无人机镜头紧贴建筑表面,快速掠过玻璃幕墙与霓虹广告牌,展现现代都市的繁华与神秘。动态模糊效果强化速度感,营造出未来科技氛围。近景至全景的连续变化,呈现壮观的城市夜景。

Prompt:一个孤独的探险者小心翼翼地穿过一个狭窄的洪水泛滥的洞穴,在狭小的空间里蹲伏着前进。她手中闪烁的火把散发出阴森的金色光芒,在她的脸上形成戏剧性的底光,同时也照亮了上方嶙峋的岩层。每走一步,水面都会泛起涟漪,火把的光芒在天花板上反射出闪闪发光的图案。阴影在洞壁上舞动,随着火焰的摇曳而变幻。空气中弥漫着浓浓的湿气,雾气在火炬的光芒中翻腾。镜头在探险者前方移动,位置较低,以突出幽闭的紧张气氛和前方的神秘深渊。超现实的纹理、电影般的灯光,以及神秘和探索的氛围。

这些提示词则考察了万相在复杂场景构建、氛围营造和细节呈现上的综合能力。它需要生成逼真的探险者形象和其小心翼翼的动作,同时渲染出狭窄且洪水泛滥的洞穴环境,包括嶙峋的岩层、水面的涟漪以及火把的动态光影效果。此外还需融入低角度镜头、超现实纹理、电影级灯光以及湿气和雾气的环境效果,显然万相的表现还不错。

英文prompt测试:Prompt:A young man, ginger hair, sings a song in front of various urban backgrounds, 80s hairstyle and outfit, wild dancing gyrations, background dancers, 80s video resolution, photorealistic, pop video.

物理建模

让模型从大量的视频数据中学到物理规律是所有视频生成模型的共同目标,因为违背物理规律的视频(比如椅子凭空飞起)会被鉴定为「一眼 AI」。万相大模型在这方面的表现让我们看到了视频生成大模型在学习物理规律方面的进展。我们给出的 prompt:透明玻璃杯在桌面倾倒,牛奶缓慢流出,液体在桌面形成蜿蜒流动轨迹,微距镜头展现液体表面张力,写实风格。模型展示出了牛奶流到桌上之后的动态痕迹,而且考虑了牛奶的粘稠度。杯子的反光特性以及牛奶与杯子接触留下的液膜也在视频中得到了还原。

技术创新

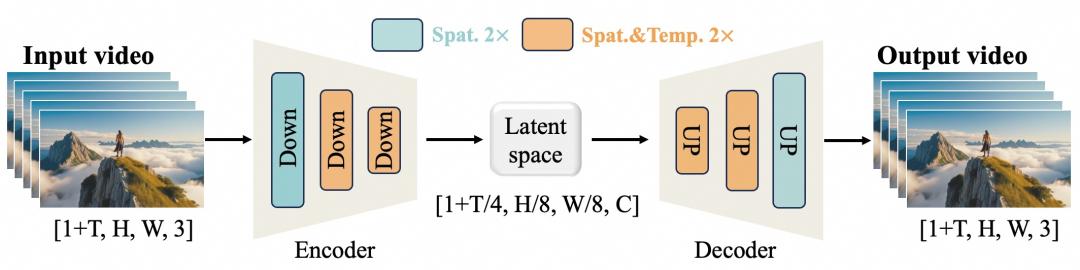

那么,问题来了,万相大模型是如何实现生成能力突破的呢?主要是两大核心创新。一个是高效的因果 3D VAE,另一个则是视频 Diffusion Transformer 。

高效的因果 3D VAE:万相团队自研了一种专为视频生成设计的新型因果 3D VAE 架构,并结合多种策略来改进时空压缩、降低内存使用以及确保时间因果性。

实验结果表明,万相的视频 VAE 在各项指标上均表现出极具竞争力的性能。在相同的硬件环境(单个 A800 GPU)下,万相的 VAE 重建速度比现有的最先进方法(如 HunYuanVideo)快 2.5 倍。

视频 Diffusion Transformer:

万相模型架构基于主流的视频 DiT 结构,通过 Full Attention 机制确保长时程时空依赖的有效建模,实现时空一致的视频生成。模型的整体训练则采用了线性噪声轨迹的流匹配(Flow Matching)方法。

如以下模型架构图所示,模型首先使用多语言 umT5 编码器对输入文本进行语义编码,并通过逐层的交叉注意力层,将文本特征向量注入到每个 Transformer Block 的特征空间,实现细粒度的语义对齐。此外,研究者通过一组在所有 Transformer Block 中共享参数的 MLP,将输入的时间步特征 T 映射为模型中 AdaLN 层的可学习缩放与偏置参数。实验发现,在相同参数规模下,这种共享时间步特征映射层参数的方法在保持模型能力同时可以显著降低参数和计算量。

此外,万相大模型还通过可扩展的预训练策略、大规模数据链路构建以及自动化评估指标,共同提升了模型的最终性能表现。